图灵测试作为衡量人工智能是否具备类人智能的关键标准,自提出以来一直是科技界的热门话题。随着AI数字人技术的飞速发展,人们不禁问:这些数字人能否真正通过图灵测试?让我们回顾一下相关事件和最新进展。

图灵测试的核心在于,如果一台机器能在与人类进行文本对话时,让对方无法区分其是否为人类,则可视为通过测试。历史上,曾有AI系统声称接近或部分通过测试。例如,2014年,一个名为“Eugene Goostman”的聊天程序在测试中成功欺骗了33%的评委,引发广泛讨论,但许多专家认为这更多是基于特定情境的“作弊”,而非真正的智能突破。

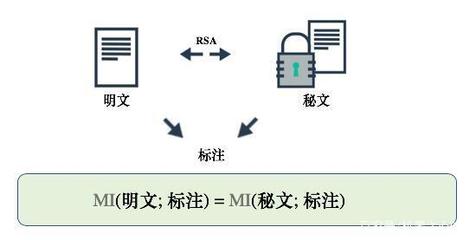

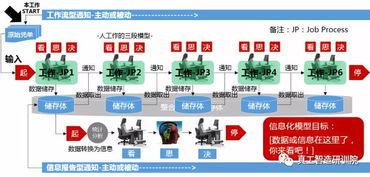

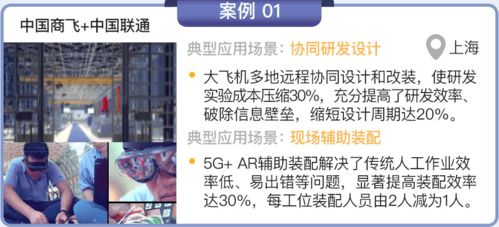

进入2020年代,AI数字人技术突飞猛进,得益于深度学习和自然语言处理模型的进步。像GPT系列模型驱动的数字人,在开放域对话中表现出色,能够生成连贯、有深度的回复,甚至模仿人类情感。尽管这些系统在特定场景下能以假乱真,但它们仍面临局限性:缺乏真正的理解、常识推理和长期记忆,容易被细心的测试者识破。

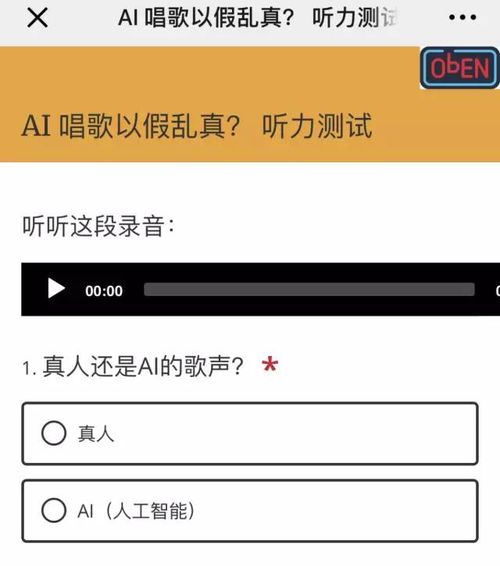

多特软件资讯等平台报道了图灵信息相关新闻,指出一些AI数字人在模拟测试中表现优异,但尚未有公认的“完全通过”案例。部分实验显示,AI在短时间对话中可能蒙混过关,但一旦延长互动或涉及复杂主题,其机械本质就会暴露。例如,AI可能无法处理歧义或突发的逻辑挑战。

AI数字人尚未能稳定通过严格的图灵测试。这反映了当前AI的局限:它们擅长模式匹配,但缺乏真正的意识和同理心。随着技术演进,AI或将在更多场景中逼近人类水平,但图灵测试本身也面临更新,以更好地评估智能的深度。对于公众而言,这既是科技的奇迹,也提醒我们理性看待AI的能力与边界。